JAX로 대규모 언어 모델 훈련하기

본 글은 JAX를 사용하여 대규모 언어 모델을 훈련하는 방법에 대한 실무자 가이드입니다.

3줄 요약

- JAX는 대규모 언어 모델 훈련을 위한 강력한 도구입니다.

- 본 가이드에서는 JAX를 사용하여 언어 모델을 훈련하는 방법을 설명합니다.

- 실무자들이 바로 행동할 수 있도록 체크리스트와 실무 적용 예시를 제공합니다.

핵심: JAX를 사용하여 대규모 언어 모델을 훈련하는 것은 복잡하지만, 본 가이드를 따라하면 쉽게 시작할 수 있습니다.

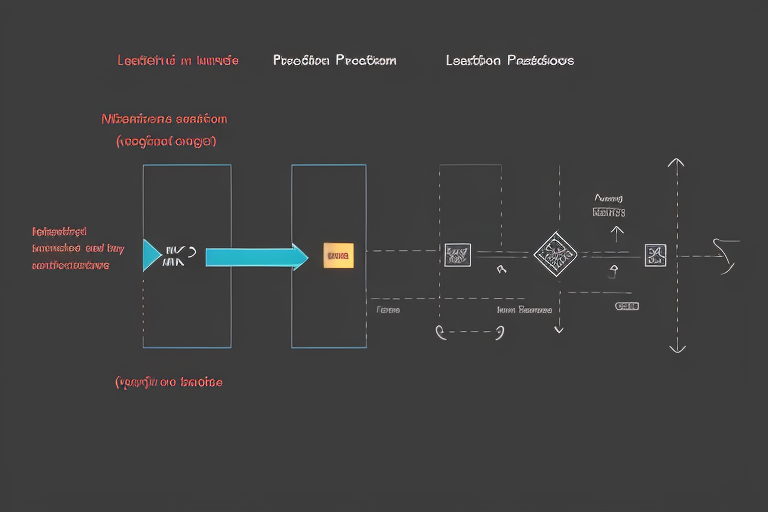

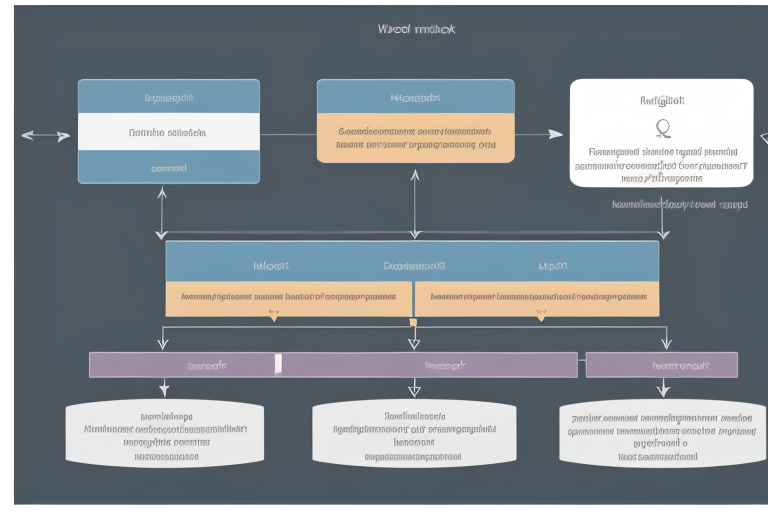

대규모 언어 모델을 훈련하는 데에는 성능, 비용, 데이터 등 여러 가지 요소가 고려되어야 합니다. JAX는 이러한 요소들을 효율적으로 관리할 수 있는 도구입니다.

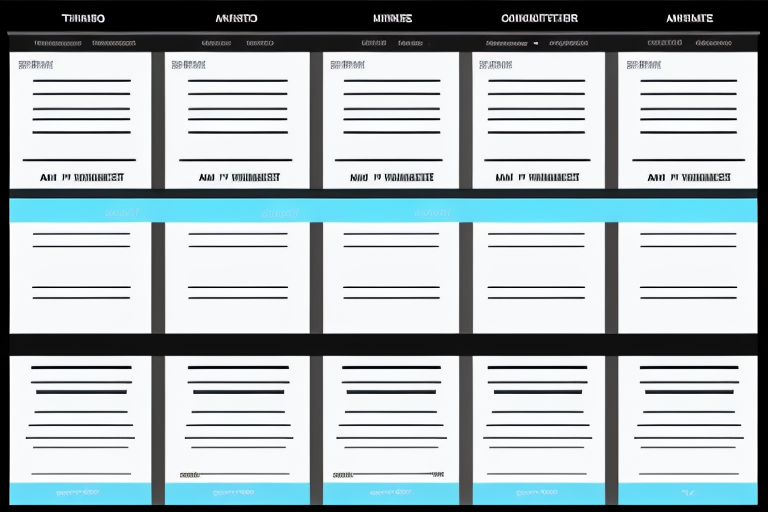

| 요소 | 설명 |

|---|---|

| 성능 | JAX는 대규모 언어 모델을 훈련하는 데 필요한 성능을 제공합니다. |

| 비용 | JAX는 비용 효율적인 대규모 언어 모델 훈련을 가능하게 합니다. |

| 데이터 | JAX는 대규모 언어 모델을 훈련하는 데 필요한 데이터를 효율적으로 관리합니다. |

요약: JAX는 대규모 언어 모델을 훈련하는 데 필요한 성능, 비용, 데이터 등을 효율적으로 관리할 수 있는 도구입니다.

체크리스트

- 권한: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 권한을 확인합니다.

- 로그: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 로그를 확인합니다.

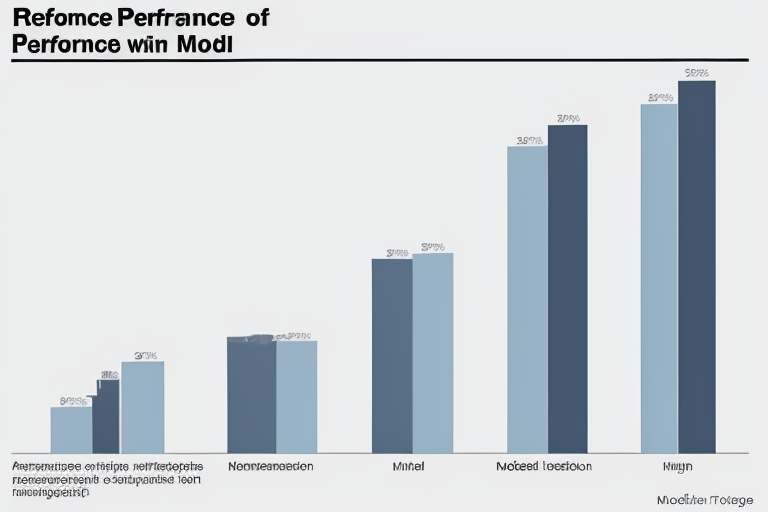

- 성능: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 성능을 확인합니다.

FAQ

Q: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 하드웨어는 무엇인가요?

A: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 하드웨어는 고성능 GPU입니다.

Q: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 소프트웨어는 무엇인가요?

A: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 소프트웨어는 JAX 라이브러리와 Python입니다.

Q: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 데이터는 무엇인가요?

A: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 데이터는 대규모 텍스트 데이터입니다.

Q: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 비용은 무엇인가요?

A: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 비용은 하드웨어와 소프트웨어의 비용입니다.

Q: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 시간은 무엇인가요?

A: JAX를 사용하여 대규모 언어 모델을 훈련하는 데 필요한 시간은 데이터의 크기와 하드웨어의 성능에 따라 다릅니다.

관련 글 추천