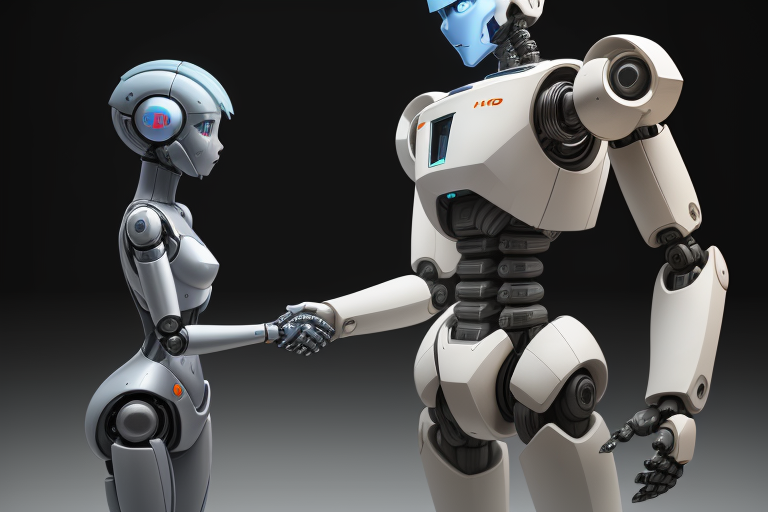

인공지능과 야만주의의 교차점

인공지능의 발전은 우리 사회에 많은 변화를 가져왔습니다. 하지만 이러한 발전은 때때로 야만주의적인 측면을 보이기도 합니다. 이 글에서는 인공지능과 야만주의의 개념을 비교하고, 인공지능이 사회에 미치는 영향에 대해 살펴보겠습니다.

3줄 요약

- 인공지능의 발전은 사회에 많은 변화를 가져옵니다.

- 인공지능은 때때로 야만주의적인 측면을 보이기도 합니다.

- 인공지능의 발전은 인간의 가치와 윤리를 재정의할 필요성을 가져옵니다.

핵심: 인공지능의 발전은 인간의 가치와 윤리를 재정의할 필요성을 가져옵니다.

인공지능은 효율성과 생산성을 향상시키는 데에 큰 역할을 합니다. 하지만 이러한 발전은 때때로 인간의 감정과 가치를 무시하는 야만주의적인 측면을 보이기도 합니다. 예를 들어, 인공지능을 이용한 자동화는 많은 일자리를 잃어버리게 만들었습니다.

| 인공지능의 발전 | 야만주의적인 측면 |

|---|---|

| 효율성과 생산성의 향상 | 인간의 감정과 가치를 무시 |

| 자동화 | 일자리 손실 |

요약: 인공지능의 발전은 효율성과 생산성의 향상을 가져오지만, 때때로 야만주의적인 측면을 보이기도 합니다.

실무 적용

인공지능을 개발하고 적용하는 데에 있어, 우리는 인간의 가치와 윤리를 고려해야 합니다. 이를 위해, 우리는 인공지능의 발전이 사회에 미치는 영향을 주의 깊게 살펴야 합니다.

- 인간의 감정과 가치를 고려

- 효율성과 생산성을 향상

- 자동화의 영향에 주의

FAQ

Q: 인공지능의 발전은 사회에 어떤 영향을 미칩니까?

A: 인공지능의 발전은 사회에 많은 변화를 가져옵니다. 효율성과 생산성의 향상, 자동화 등이 있습니다.

Q: 인공지능은 야만주의적인 측면을 보이기도 합니까?

A: 예, 인공지능은 때때로 야만주의적인 측면을 보이기도 합니다. 인간의 감정과 가치를 무시하는 경우가 있습니다.

Q: 인공지능의 발전은 인간의 가치와 윤리를 재정의할 필요성을 가져오나요?

A: 예, 인공지능의 발전은 인간의 가치와 윤리를 재정의할 필요성을 가져옵니다.

Q: 인공지능을 개발하고 적용하는 데에 있어, 무엇을 고려해야 합니까?

A: 인공지능을 개발하고 적용하는 데에 있어, 우리는 인간의 가치와 윤리를 고려해야 합니다.

Q: 인공지능의 발전이 사회에 미치는 영향을 주의 깊게 살펴야 합니까?

A: 예, 인공지능의 발전이 사회에 미치는 영향을 주의 깊게 살펴야 합니다.

관련 글 추천