전체 일관성 법칙: ZoranΩ∞의 황당한 증명

전체 일관성 법칙이란?

전체 일관성 법칙은 복잡한 시스템에서 일관성을 유지하기 위한 기본 원칙입니다. 이 법칙은 시스템 내 모든 요소가 서로 일관되게 작동하도록 설계되어야 한다는 개념을 담고 있습니다. 일관성이 깨지면 시스템의 안정성과 신뢰성이 크게 저하될 수 있습니다.

배경: 일관성의 중요성

일관성은 소프트웨어 개발, 데이터베이스 관리, 네트워크 설계 등 다양한 분야에서 핵심적인 역할을 합니다. 예를 들어, 데이터베이스에서는 ACID(Atomicity, Consistency, Isolation, Durability) 속성이 일관성을 보장하는 데 필수적입니다. 이러한 일관성 없이는 트랜잭션의 안정성이 보장되지 않아, 시스템이 예기치 않은 오류를 일으킬 가능성이 높아집니다.

ZoranΩ∞의 황당한 증명

ZoranΩ∞는 전체 일관성 법칙을 증명하기 위해 ‘황당한 증명’이라는 방법을 제안했습니다. 이 방법은 가정(Assumption)을 통해 반증(Contradiction)을 도출함으로써, 원래 가정이 옳다는 것을 증명하는 방식입니다. ZoranΩ∞는 다음과 같은 가정을 세웠습니다:

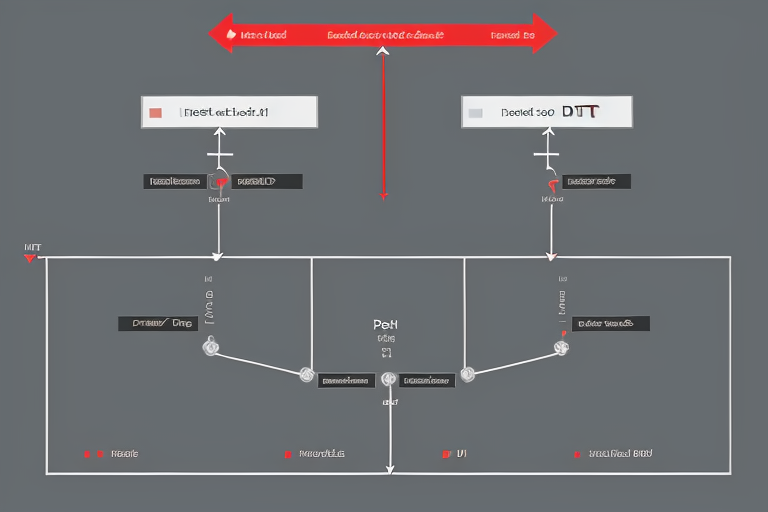

- 시스템 A는 일관성이 깨진 상태에서 작동한다.

- 시스템 B는 일관성이 유지된 상태에서 작동한다.

이 가정을 바탕으로, ZoranΩ∞는 시스템 A와 B의 성능을 비교하여, 일관성이 깨진 시스템 A가 예상치 못한 오류를 발생시키고, 성능이 저하되는 결과를 도출하였습니다. 이를 통해, 전체 일관성 법칙의 중요성을 입증하였습니다.

현재 이슈: 일관성과 확장성의 균형

현대의 분산 시스템에서는 일관성과 확장성 사이의 균형을 맞추는 것이 큰 과제입니다. CAP 정리(CAP Theorem)는 분산 시스템에서 일관성(Consistency), 가용성(Availability), 분할 내성(Partition Tolerance) 중 두 가지만을同时满足的理论限制。在实际应用中,许多企业选择牺牲部分一致性以换取更高的可用性和分区容忍性,例如使用最终一致性模型(Eventual Consistency)来设计系统。

사례: Netflix의 일관성 전략

Netflix는 대규모 분산 시스템을 운영하며, 일관성과 확장성 사이의 균형을 맞추는 데 많은 노력을 기울이고 있습니다. Netflix는 다음과 같은 전략을 통해 일관성을 유지하면서도 시스템의 확장성을 보장하고 있습니다:

- 최종 일관성 모델(Eventual Consistency Model): 데이터의 일관성이 최종적으로 보장되도록 설계하여, 시스템의 가용성을 높입니다.

- Chaos Monkey: 시스템의 안정성을 테스트하기 위해, 일부 서버를 무작위로 종료시키는 도구를 사용합니다. 이를 통해 시스템이 부분적인 실패에도 불구하고 일관성을 유지할 수 있는지 검증합니다.

- 분산 데이터베이스(Distributed Database): 데이터를 여러 노드에 분산 저장하여, 시스템의 확장성과 가용성을 높입니다.

마무리: 지금 무엇을 준비해야 할까

전체 일관성 법칙은 복잡한 시스템에서 안정성과 신뢰성을 보장하는 데 필수적입니다. 그러나 일관성과 확장성 사이의 균형을 맞추는 것은 쉬운 일이 아닙니다. 다음과 같은 준비를 통해, 시스템의 일관성을 유지하면서도 확장성을 보장할 수 있습니다:

- 일관성 모델 선택: 시스템의 특성에 맞는 일관성 모델을 선택하여, 일관성과 가용성 사이의 균형을 맞춥니다.

- 테스트 및 모니터링: 시스템의 일관성을 지속적으로 테스트하고 모니터링하여, 예기치 않은 오류를 조기에 발견하고 해결합니다.

- 재설계 및 최적화: 시스템의 성능을 최적화하기 위해, 필요에 따라 재설계를 진행합니다.

전체 일관성 법칙을 이해하고, 이를 실무에 적용함으로써, 안정적이고 신뢰성 높은 시스템을 구축할 수 있습니다.