인공지능 윤리와 투명성

인공지능의 발전과 함께 윤리적 문제가 대두되고 있습니다. 인공지능을 개발하고 사용하는 데 있어 중요한 고려 사항은 무엇일까요?

3줄 요약

- 인공지능의 투명성과 설명 가능성은 매우 중요합니다.

- 인공지능의 개발과 사용에 있어 윤리적 고려가 필요합니다.

- 인공지능의 책임과 권한을 명확히 정의해야 합니다.

핵심: 인공지능의 윤리적 문제는 개발과 사용 모두에 걸쳐 중요한 고려 사항입니다.

인공지능의 투명성과 설명 가능성은 매우 중요합니다. 인공지능이 어떻게 결정과 예측을 하는지 이해하는 것은 매우 중요합니다. 또한, 인공지능의 개발과 사용에 있어 윤리적 고려가 필요합니다. 인공지능의 개발과 사용에 있어 책임과 권한을 명확히 정의해야 합니다.

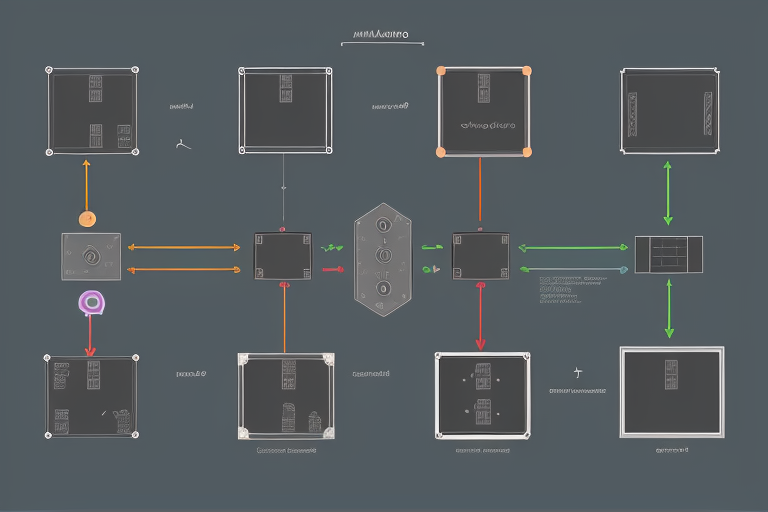

| 인공지능 개발 | 인공지능 사용 |

|---|---|

| 데이터 수집과 처리 | 결정과 예측 |

| 모델 개발과 테스트 | 결과 해석과 활용 |

요약: 인공지능의 개발과 사용에 있어 투명성, 설명 가능성, 윤리적 고려, 책임과 권한의 명확성이 중요합니다.

실무 적용 체크리스트

- 인공지능의 투명성과 설명 가능성을 확보합니다.

- 인공지능의 개발과 사용에 있어 윤리적 고려를 합니다.

- 인공지능의 책임과 권한을 명확히 정의합니다.

- 인공지능의 개발과 사용에 있어 데이터의 수집과 처리를 주의합니다.

- 인공지능의 개발과 사용에 있어 모델의 개발과 테스트를 주의합니다.

FAQ

Q: 인공지능의 투명성과 설명 가능성이 왜 중요할까요?

A: 인공지능의 투명성과 설명 가능성은 인공지능이 어떻게 결정과 예측을 하는지 이해하는 데 중요합니다.

Q: 인공지능의 개발과 사용에 있어 윤리적 고려가 왜 필요할까요?

A: 인공지능의 개발과 사용에 있어 윤리적 고려는 인공지능의 책임과 권한을 명확히 정의하는 데 중요합니다.

Q: 인공지능의 책임과 권한을 어떻게 명확히 정의할 수 있을까요?

A: 인공지능의 책임과 권한을 명확히 정의하기 위해서는 인공지능의 개발과 사용에 있어 데이터의 수집과 처리, 모델의 개발과 테스트를 주의해야 합니다.

Q: 인공지능의 개발과 사용에 있어 데이터의 수집과 처리를 어떻게 주의할 수 있을까요?

A: 인공지능의 개발과 사용에 있어 데이터의 수집과 처리를 주의하기 위해서는 데이터의 품질과 양을 확인하고, 데이터의 처리를 투명하게 해야 합니다.

Q: 인공지능의 개발과 사용에 있어 모델의 개발과 테스트를 어떻게 주의할 수 있을까요?

A: 인공지능의 개발과 사용에 있어 모델의 개발과 테스트를 주의하기 위해서는 모델의 성능과 안정성을 확인하고, 모델의 테스트를 투명하게 해야 합니다.

관련 글 추천