AI 모델 성능이 좋아지면 서비스는 왜 그대로일까? : 제품화의 함정

최신 LLM의 벤치마크 점수 상승이 실제 사용자 경험으로 이어지지 않는 이유를 분석하고, 기술적 가능성을 비즈니스 가치로 전환하는 실무 전략을 제시합니다.

성능 지표의 배신: 벤치마크 점수가 높으면 성공할까?

많은 개발자와 제품 매니저들이 범하는 가장 흔한 오류는 ‘더 강력한 모델을 쓰면 제품의 품질이 자동으로 올라갈 것’이라는 믿음입니다. GPT-4에서 Claude 3.5로, 혹은 Llama 3로 모델을 교체했을 때 벤치마크 점수가 10% 상승했다고 해서 사용자가 느끼는 만족도가 10% 상승하는 경우는 거의 없습니다. 오히려 모델의 추론 능력이 정교해질수록, 기존에 설계된 프롬프트와 워크플로우가 충돌하며 예상치 못한 ‘회귀 오류(Regression Error)’가 발생하는 사례가 빈번합니다.

우리는 지금 모델의 성능(Capability)과 제품의 효용(Utility) 사이의 거대한 간극에 직면해 있습니다. 모델이 수학 문제를 더 잘 풀게 되었다고 해서, 고객 상담 챗봇이 더 친절해지거나 복잡한 기업 내부 데이터를 더 정확하게 찾아주는 것은 아닙니다. 결국 핵심은 모델 그 자체가 아니라, 그 모델을 어떻게 제품의 맥락(Context) 속에 녹여내느냐는 ‘제품화(Productization)’의 역량에 달려 있습니다.

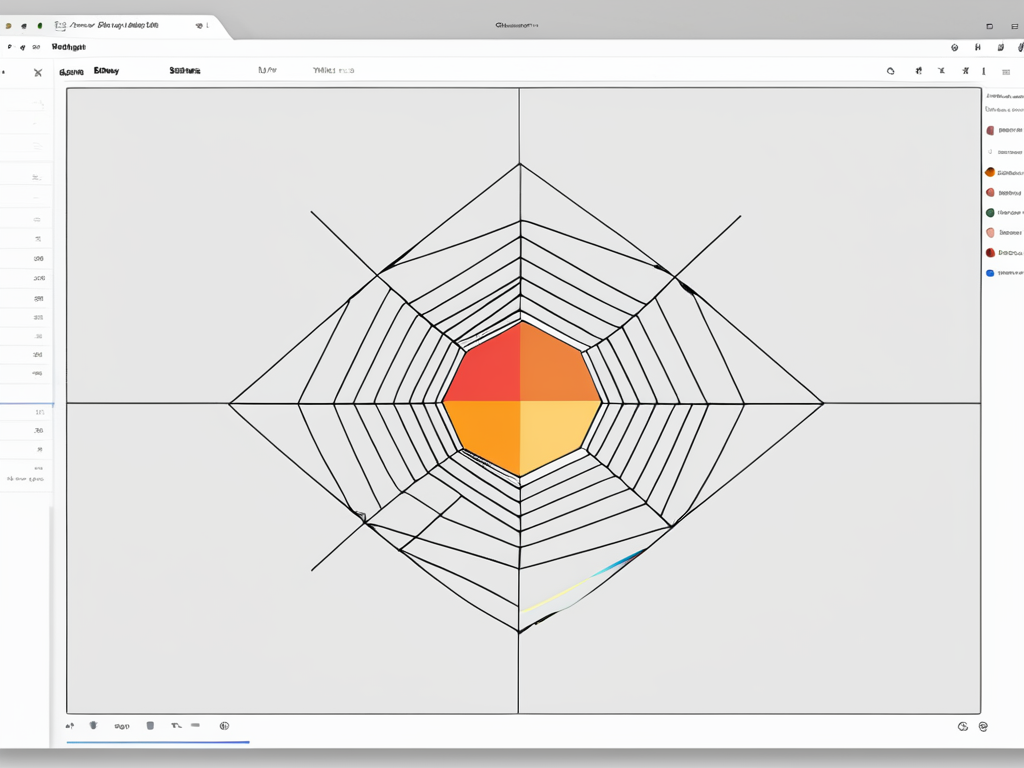

AI 모델의 성능과 실제 채택 사이의 괴리

AI 모델의 능력이 향상됨에도 불구하고 실제 현업에서의 채택 속도가 더딘 이유는 기술적 한계보다는 운영적, 심리적 허들이 더 크기 때문입니다. 모델의 추론 능력이 올라가면 필연적으로 토큰 사용량이 늘어나거나 응답 지연 시간(Latency)이 증가하는 경향이 있습니다. 실시간 응답이 중요한 서비스에서 0.1초의 지연은 사용자 이탈로 이어지며, 이는 모델의 지능적 우위보다 더 치명적인 결함이 됩니다.

또한, 모델의 ‘범용적 능력’과 ‘특수 목적의 정확도’는 서로 다른 영역입니다. 일반적인 상식 퀴즈에서 만점을 받는 모델이라도, 특정 회사의 복잡한 정산 규정을 해석하는 데 있어서는 튜닝되지 않은 소형 모델보다 못한 성능을 보일 수 있습니다. 여기서 발생하는 신뢰의 붕괴는 사용자가 AI 기능을 완전히 포기하게 만드는 결정적인 계기가 됩니다.

기술적 구현: 단순 API 호출을 넘어 시스템으로

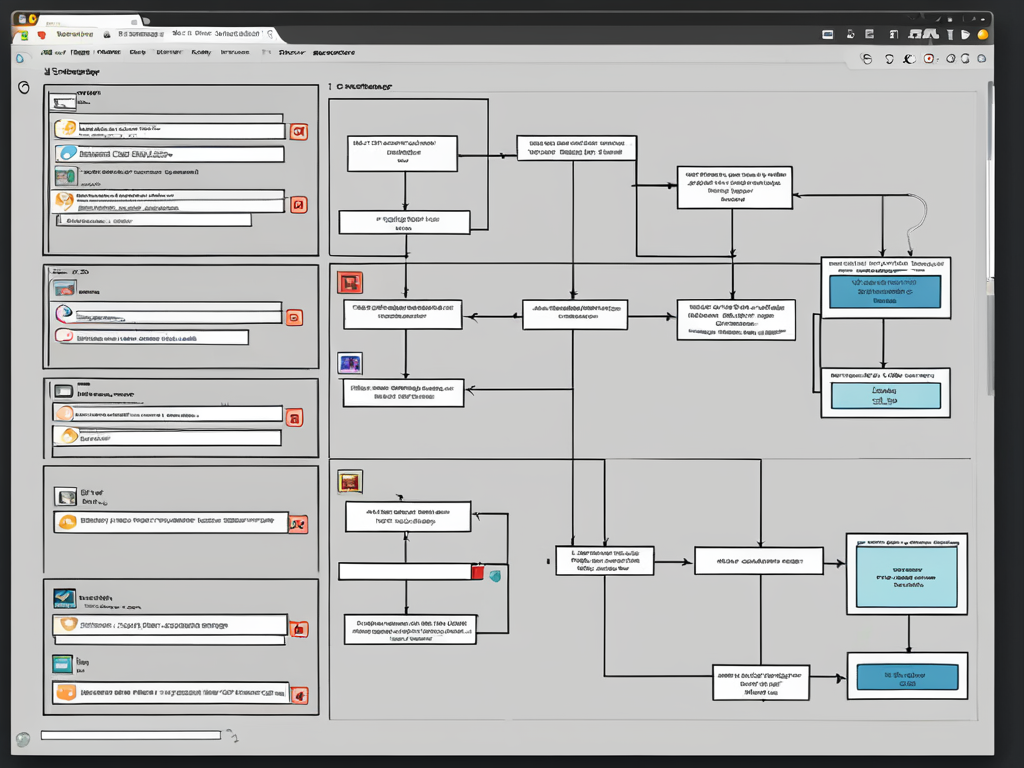

단순히 API를 연결해 결과를 출력하는 단계에서 벗어나려면, AI를 하나의 ‘함수’가 아닌 ‘시스템’으로 바라봐야 합니다. 고성능 모델을 효율적으로 활용하기 위한 아키텍처 설계는 다음과 같은 방향으로 나아가야 합니다.

- 하이브리드 라우팅: 모든 요청을 최상위 모델로 보내는 것이 아니라, 요청의 난이도를 분류하여 단순 작업은 경량 모델(SLM)이, 복잡한 추론은 고성능 모델(LLM)이 처리하게 함으로써 비용과 속도를 최적화해야 합니다.

- 가드레일 설계: 모델의 창의성이 독이 되지 않도록 출력 형식을 강제하고, 금지어 및 환각(Hallucination)을 필터링하는 독립적인 검증 레이어를 구축해야 합니다.

- 피드백 루프의 자동화: 사용자의 ‘좋아요/싫어요’ 데이터를 단순히 수집하는 것에 그치지 않고, 이를 다시 프롬프트 최적화나 파인튜닝 데이터셋으로 전환하는 파이프라인을 구축하는 것이 핵심입니다.

모델 성능 향상의 득과 실: 트레이드오프 분석

최신 모델 도입 시 고려해야 할 기술적, 기능적 장단점을 분석하면 다음과 같습니다.

| 구분 | 고성능 모델 도입 시 이점 (Pros) | 잠재적 리스크 및 단점 (Cons) |

|---|---|---|

| 기술적 측면 | 복잡한 지시사항 이행 능력 향상, 제로샷 성능 개선 | 추론 비용 증가, 응답 속도 저하, API 의존도 심화 |

| 기능적 측면 | 더 자연스러운 대화 흐름, 다국어 처리 능력 강화 | 과도한 친절함으로 인한 핵심 정보 누락, 예측 불가능한 출력 |

실제 적용 사례: 도구의 최적화가 만드는 차이

최근의 한 사례를 살펴보면, 매일 만화를 게시하는 자동화 툴을 만든 개발자의 경험에서 중요한 힌트를 얻을 수 있습니다. 그는 단순히 ‘그림을 잘 그리는 AI’를 찾는 것에 그치지 않고, 크롬 익스텐션이라는 인터페이스를 통해 AI의 출력을 실제 게시물 형태로 빠르게 변환하는 ‘워크플로우’를 구축했습니다. 여기서 핵심은 AI 모델의 화풍이 얼마나 뛰어난가가 아니라, ‘아이디어 생성 → 이미지 생성 → 플랫폼 게시’라는 전체 프로세스에서 마찰(Friction)을 얼마나 줄였느냐에 있었습니다.

이는 기업용 솔루션에도 동일하게 적용됩니다. RAG(검색 증강 생성) 시스템을 구축할 때, 최신 모델을 쓰는 것보다 데이터의 청킹(Chunking) 전략을 수정하거나 검색 알고리즘을 개선했을 때 답변의 정확도가 더 비약적으로 상승하는 경우가 많습니다. 결국 사용자가 느끼는 가치는 모델의 지능이 아니라, 내 문제가 얼마나 빠르고 정확하게 해결되었는가에서 옵니다.

실무자를 위한 단계별 액션 가이드

지금 당장 AI 제품의 성능을 개선하고 채택률을 높이고 싶다면 다음의 단계를 밟으십시오.

- 성능 지표의 재정의: 벤치마크 점수가 아닌, ‘작업 완료율(Task Completion Rate)’과 ‘사용자 수정 횟수’를 핵심 지표(KPI)로 설정하십시오.

- 에러 분석의 정량화: 모델이 틀린 답변을 내놓았을 때, 그것이 ‘지식의 부족’인지 ‘지시사항 이해 부족’인지 ‘데이터 검색 실패’인지 분류하여 기록하십시오.

- 최소 기능 모델(Minimum Viable Model) 탐색: 가장 비싼 모델이 아닌, 해당 기능을 수행할 수 있는 가장 작고 빠른 모델을 먼저 찾아내고, 부족한 부분만 상위 모델로 보완하는 구조를 설계하십시오.

- 사용자 인터페이스(UI)의 보완: AI의 불확실성을 인정하고, 사용자가 쉽게 수정하거나 다시 생성할 수 있는 UI 장치를 마련하여 심리적 허들을 낮추십시오.

결론: 지능의 시대에서 구현의 시대로

AI 모델의 성능 경쟁은 이제 상향 평준화 단계에 접어들고 있습니다. 이제 승부처는 ‘누가 더 똑똑한 모델을 쓰는가’가 아니라 ‘누가 더 영리하게 모델을 제품에 녹여내는가’로 옮겨갔습니다. 기술적 가능성에 매몰되지 않고, 사용자가 겪는 실제 불편함의 지점을 정확히 타격하는 제품 설계만이 AI 거품론을 넘어 실질적인 비즈니스 가치를 창출할 수 있습니다.

결국 AI는 목적지가 아니라 수단입니다. 모델의 성능 수치에 일희일비하기보다, 그 성능이 사용자의 시간을 얼마나 단축시켰는지, 혹은 어떤 새로운 가치를 만들어냈는지에 집중하십시오. 그것이 바로 기술적 우위를 시장의 우위로 바꾸는 유일한 방법입니다.

FAQ

I Built My Own Chrome Extension and Started Posting Daily Manga (Days 13–15)의 핵심 쟁점은 무엇인가요?

핵심 문제 정의, 비용 구조, 실제 적용 방법, 리스크를 함께 봐야 합니다.

I Built My Own Chrome Extension and Started Posting Daily Manga (Days 13–15)를 바로 도입해도 되나요?

작은 범위에서 실험하고 데이터를 확인한 뒤 단계적으로 확대하는 편이 안전합니다.

실무에서 가장 먼저 확인할 것은 무엇인가요?

목표 지표, 대상 사용자, 예산 범위, 운영 책임자를 먼저 명확히 해야 합니다.

법률이나 정책 이슈도 함께 봐야 하나요?

네. 데이터 수집 방식, 플랫폼 정책, 개인정보 관련 제한을 반드시 점검해야 합니다.

성과를 어떻게 측정하면 좋나요?

비용, 전환율, 클릭률, 운영 공수, 재사용 가능성 같은 지표를 함께 보는 것이 좋습니다.

관련 글 추천

- https://infobuza.com/2026/04/27/20260427-q9gvz2/

- https://infobuza.com/2026/04/27/20260427-bncv56/

지금 바로 시작할 수 있는 실무 액션

- 현재 팀의 AI 활용 범위와 검증 절차를 먼저 문서화합니다.

- 작은 파일럿 프로젝트로 KPI를 정하고 2~4주 단위로 검증합니다.

- 보안, 품질, 리뷰 기준을 자동화 도구와 함께 연결합니다.