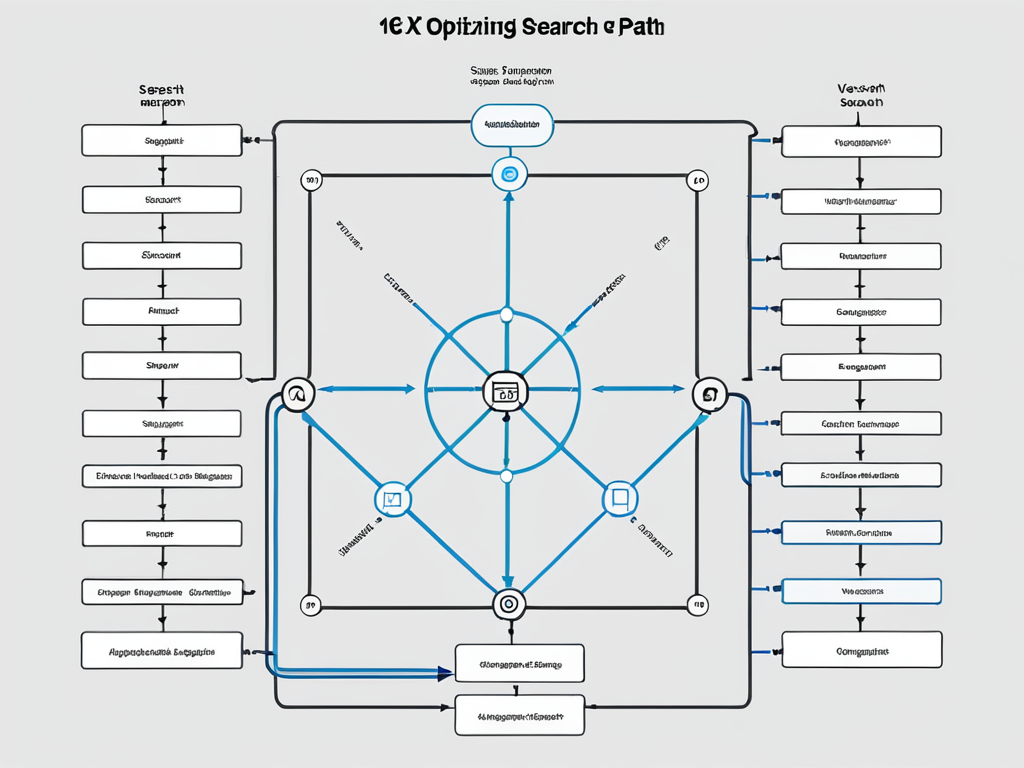

알고리즘은 그대로인데 16배 빨라졌다? 벡터 검색 엔진 최적화의 비밀

단순한 로직 변경 없이 코드의 '핫 패스' 최적화만으로 성능을 극대화하는 하드웨어 가속과 메모리 레이아웃 전략을 분석합니다.

성능의 병목, 알고리즘이 아니라 ‘구현’에 있다

많은 개발자가 시스템 성능을 개선해야 할 때 가장 먼저 생각하는 것은 ‘더 효율적인 알고리즘’을 찾는 것입니다. 시간 복잡도를 O(n log n)에서 O(n)으로 줄이거나, 완전히 새로운 데이터 구조를 도입하려는 시도를 하죠. 하지만 실제 대규모 시스템, 특히 벡터 검색 엔진과 같이 연산 집약적인 환경에서는 알고리즘의 논리적 구조보다 데이터가 메모리에서 CPU로 어떻게 이동하고, CPU가 이를 어떻게 처리하는가라는 ‘구현의 디테일’이 성능을 결정짓는 결정적인 요소가 됩니다.

벡터 검색 엔진의 핵심은 수백만, 수천만 개의 고차원 벡터 사이에서 유사도가 가장 높은 항목을 빠르게 찾아내는 것입니다. 여기서 발생하는 대부분의 연산은 단순한 곱셈과 덧셈의 반복인 내적(Dot Product)이나 유클리드 거리 계산입니다. 논리적으로는 매우 단순한 연산이지만, 이 과정이 수십억 번 반복될 때 발생하는 ‘핫 패스(Hot Path)’의 비효율은 시스템 전체의 응답 속도를 갉아먹는 주범이 됩니다. 알고리즘을 바꾸지 않고도 16배의 성능 향상을 이끌어냈다는 것은, 우리가 흔히 간과하는 하드웨어 수준의 최적화가 얼마나 강력한지를 보여주는 사례입니다.

핫 패스(Hot Path) 최적화란 무엇인가

소프트웨어 실행 흐름 중에서 가장 빈번하게 호출되어 전체 실행 시간의 대부분을 차지하는 코드 구간을 ‘핫 패스’라고 부릅니다. 벡터 검색에서 핫 패스는 단연코 ‘거리 계산 루프’입니다. 이 구간에서 발생하는 미세한 지연 시간은 루프 횟수만큼 곱해져 거대한 성능 저하로 이어집니다. 핫 패스 최적화의 핵심은 CPU가 쉬지 않고 일하게 만드는 것, 즉 CPU 파이프라인의 효율을 극대화하고 메모리 대기 시간을 최소화하는 데 있습니다.

16배 속도 향상을 만드는 기술적 메커니즘

단순한 루프를 16배 빠르게 만들기 위해서는 현대 CPU의 아키텍처를 깊게 이해해야 합니다. 단순히 코드를 깔끔하게 짜는 것이 아니라, 하드웨어가 좋아하는 방식으로 데이터를 제공해야 합니다.

- SIMD(Single Instruction, Multiple Data) 활용: 현대의 CPU는 한 번의 명령어로 여러 개의 데이터를 동시에 처리할 수 있는 SIMD 명령어 셋(AVX-2, AVX-512 등)을 가지고 있습니다. 기존의 스칼라 연산이 벡터의 원소를 하나씩 곱하고 더했다면, SIMD를 적용하면 8개 혹은 16개의 원소를 한 번에 처리할 수 있습니다. 이것만으로도 이론상 8~16배의 속도 향상이 가능합니다.

- 메모리 정렬(Memory Alignment)과 캐시 효율성: CPU는 메모리에서 데이터를 가져올 때 바이트 단위가 아니라 ‘캐시 라인’ 단위로 가져옵니다. 데이터가 메모리에 흩어져 있으면 CPU는 계속해서 메인 메모리에 접근해야 하며, 이는 심각한 지연(Latency)을 초래합니다. 데이터를 연속적인 메모리 블록에 배치하고(Data Locality), 캐시 라인 크기에 맞춰 정렬함으로써 캐시 미스를 획기적으로 줄일 수 있습니다.

- 루프 언롤링(Loop Unrolling)과 파이프라이닝: 루프의 조건 검사 횟수를 줄이기 위해 루프 내부의 연산을 수동으로 펼치는 기법입니다. 이를 통해 CPU의 분기 예측(Branch Prediction) 실패 가능성을 낮추고, 명령어 수준 병렬성(ILP)을 높여 파이프라인 효율을 극대화합니다.

최적화의 트레이드오프: 얻는 것과 잃는 것

이러한 저수준 최적화는 강력하지만 공짜가 아닙니다. 엔지니어는 성능과 유지보수성 사이의 치열한 고민을 해야 합니다.

| 구분 | 최적화 전 (Generic Code) | 최적화 후 (Optimized Hot Path) |

|---|---|---|

| 가독성 | 높음 (표준 라이브러리 사용) | 낮음 (인트린직 함수, 복잡한 포인터 연산) |

| 이식성 | 매우 높음 (모든 CPU 작동) | 낮음 (특정 CPU 명령어 셋에 종속) |

| 개발 속도 | 빠름 | 느긋함 (정밀한 프로파일링 필요) |

| 실행 속도 | 기준점 (1x) | 비약적 상승 (최대 16x) |

가장 큰 문제는 ‘이식성’입니다. AVX-512를 사용하여 최적화한 코드는 해당 명령어를 지원하지 않는 구형 CPU에서는 작동하지 않습니다. 따라서 실제 상용 엔진에서는 CPU의 기능을 런타임에 감지하여, 지원하는 최적화 수준에 맞는 서로 다른 코드 경로(Code Path)를 실행하는 ‘동적 디스패칭’ 전략을 사용합니다.

실무 적용 사례: 벡터 DB의 진화

실제로 Milvus나 FAISS 같은 고성능 벡터 라이브러리들은 이러한 최적화의 집합체입니다. 이들은 단순히 HNSW(Hierarchical Navigable Small World) 같은 알고리즘을 구현하는 데 그치지 않고, 각 하드웨어 벤더(Intel, AMD, NVIDIA)가 제공하는 최적화 라이브러리를 통합합니다. 예를 들어, CPU에서는 MKL(Math Kernel Library)을 사용하고 GPU에서는 CUDA 코어를 활용해 수천 개의 스레드가 동시에 거리 계산을 수행하게 함으로써, 알고리즘의 복잡도를 낮추지 않고도 처리량을 기하급수적으로 늘렸습니다.

지금 당장 실행할 수 있는 액션 아이템

모든 코드를 저수준으로 짤 필요는 없습니다. 하지만 성능이 중요한 서비스의 엔지니어라면 다음의 단계를 밟아보길 권장합니다.

- 프로파일링 우선: 짐작으로 최적화하지 마십시오.

perf,VTune,pprof같은 도구를 사용하여 실제로 어디서 시간이 가장 많이 소요되는지 ‘핫 패스’를 정확히 찾아내십시오. - 데이터 레이아웃 재설계: 객체 지향적인 ‘배열의 객체(Array of Structures)’ 방식에서 ‘객체의 배열(Structure of Arrays)’ 방식으로 데이터 구조를 변경해 보십시오. 이는 CPU 캐시 적중률을 높이는 가장 빠른 방법입니다.

- 컴파일러 힌트 활용: 최신 컴파일러는 매우 똑똑합니다.

restrict키워드를 사용하여 포인터 앨리어싱을 방지하거나, 루프 최적화 프라그마를 사용하여 컴파일러가 자동으로 SIMD화를 수행하도록 유도하십시오. - 벤치마크 자동화: 미세한 최적화가 실제 성능 향상으로 이어졌는지 확인하기 위해 마이크로 벤치마크 환경을 구축하십시오.

결론: 본질은 하드웨어와의 조화

알고리즘은 소프트웨어의 ‘설계도’이지만, 최적화는 그 설계도를 ‘실제 물리적 세계(하드웨어)’에 어떻게 구현하느냐의 문제입니다. 16배의 성능 향상은 마법 같은 새로운 알고리즘이 아니라, CPU가 데이터를 처리하는 방식에 순응하고 그 잠재력을 끝까지 끌어올린 결과입니다. 결국 최고의 성능은 알고리즘의 효율성과 하드웨어의 특성이 완벽하게 맞물릴 때 완성됩니다.

FAQ

Same algorithm, 16x faster: optimizing a vector search engines hot path의 핵심 쟁점은 무엇인가요?

핵심 문제 정의, 비용 구조, 실제 적용 방법, 리스크를 함께 봐야 합니다.

Same algorithm, 16x faster: optimizing a vector search engines hot path를 바로 도입해도 되나요?

작은 범위에서 실험하고 데이터를 확인한 뒤 단계적으로 확대하는 편이 안전합니다.

실무에서 가장 먼저 확인할 것은 무엇인가요?

목표 지표, 대상 사용자, 예산 범위, 운영 책임자를 먼저 명확히 해야 합니다.

법률이나 정책 이슈도 함께 봐야 하나요?

네. 데이터 수집 방식, 플랫폼 정책, 개인정보 관련 제한을 반드시 점검해야 합니다.

성과를 어떻게 측정하면 좋나요?

비용, 전환율, 클릭률, 운영 공수, 재사용 가능성 같은 지표를 함께 보는 것이 좋습니다.

관련 글 추천

- https://infobuza.com/2026/04/29/20260429-oj0wwp/

- https://infobuza.com/2026/04/29/20260429-qgfu1f/

지금 바로 시작할 수 있는 실무 액션

- 현재 팀의 AI 활용 범위와 검증 절차를 먼저 문서화합니다.

- 작은 파일럿 프로젝트로 KPI를 정하고 2~4주 단위로 검증합니다.

- 보안, 품질, 리뷰 기준을 자동화 도구와 함께 연결합니다.