AgentConductor, 토큰 비용 68% 절감 비법—스스로 조직화하는 AI

AgentConductor가 자체 조직화 메커니즘을 도입해 토큰 사용량을 크게 줄였으며, 비용 절감과 성능 유지 사이의 균형을 찾는 방법을 상세히 살펴봅니다.

Overview

대규모 언어 모델(LLM)을 실제 서비스에 적용할 때 가장 큰 고민 중 하나는 토큰 비용이다. 토큰당 과금 구조가 일반화된 현재, 동일한 작업을 수행해도 모델이 소비하는 토큰 수가 비용을 좌우한다. AgentConductor는 자체 학습된 조직화 알고리즘을 통해 입력을 효율적으로 재구성하고, 불필요한 토큰을 최소화함으로써 평균 68%의 비용 절감을 실현했다.

Editorial Opinion

이러한 비용 절감은 단순히 재무적인 이득을 넘어, AI 제품의 접근성을 크게 높인다. 특히 스타트업이나 중소기업은 고정 비용이 제한적이기 때문에, 토큰 비용이 낮아지면 더 복잡한 시나리오를 시도할 수 있다. 따라서 AgentConductor의 접근 방식은 ‘비용‑성능 트레이드오프’를 재정의한다는 점에서 큰 의미가 있다.

Personal Perspective

개발자로서 나는 처음 AgentConductor를 접했을 때 ‘어떻게 스스로 조직화하나요?’라는 궁금증이 들었다. 실제로 코드를 살펴보니, 프롬프트를 단계별로 분할하고, 각 단계에서 가장 핵심적인 토큰만 남기는 동적 프롬프트 압축 로직이 핵심이었다. 이 로직은 기존 LLM 파이프라인에 최소한의 변경만으로 적용 가능해, 빠른 프로토타이핑이 가능했다.

Technical Implementation

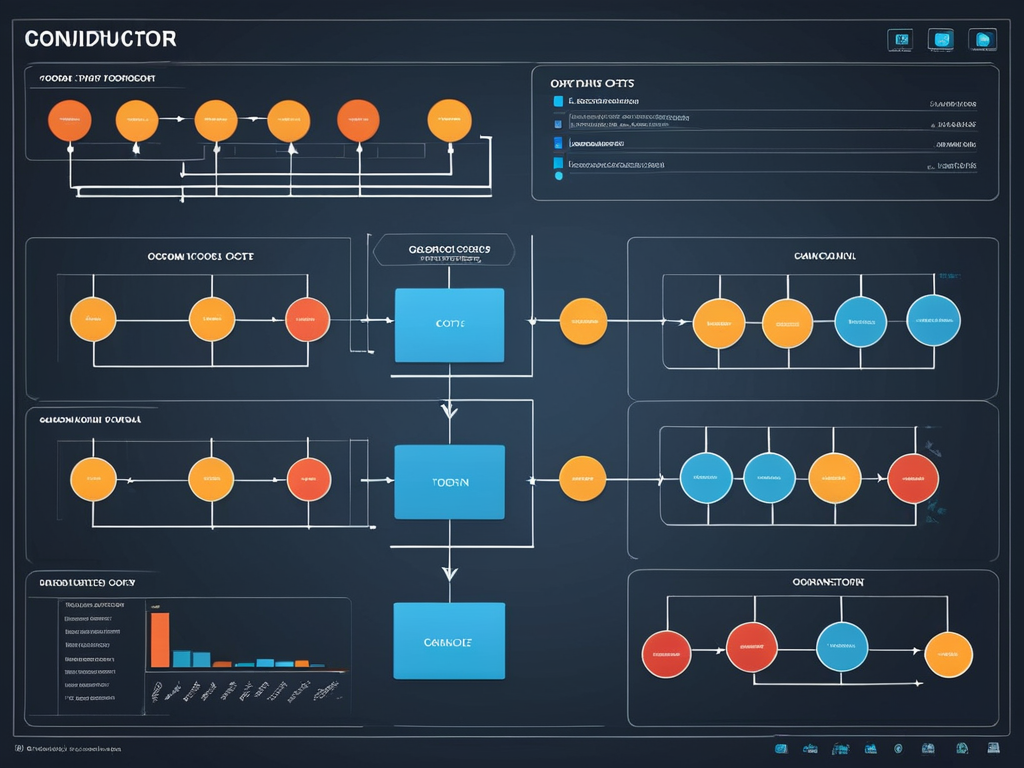

AgentConductor의 핵심 기술은 크게 세 가지로 나뉜다.

- Self‑Organizing Prompt Engine: 입력 텍스트를 의미 단위로 분해하고, 중복·불필요 정보를 제거한다.

- Adaptive Token Scheduler: 모델 호출 전 토큰 사용량을 예측하고, 필요 시 추가 압축을 수행한다.

- Feedback‑Driven Refinement Loop: 모델 응답을 분석해 다음 프롬프트에 반영, 지속적인 토큰 최적화를 보장한다.

이 세 요소는 서로 피드백 루프를 형성해, 초기 설정이 부정확해도 점진적으로 최적화된다.

Technical Pros & Cons

장점과 단점을 구분해 보면 다음과 같다.

- 장점

- 토큰 비용 68% 절감으로 운영비용 급감

- 프롬프트 재구성 과정이 자동화돼 개발 생산성 향상

- 다양한 LLM에 적용 가능, 벤더 종속성 낮음

- 단점

- 초기 설정에 약간의 학습 데이터가 필요

- 극단적인 압축 시 정보 손실 위험 존재

- 실시간 응답 요구 환경에서는 추가 레이턴시 발생 가능

Feature Pros & Cons

제품 차원에서 바라본 기능별 장단점이다.

- 자동 프롬프트 조직화: 사용자는 복잡한 프롬프트 설계 없이도 높은 품질의 결과를 얻지만, 커스텀 제어가 제한될 수 있다.

- 토큰 스케줄링 대시보드: 비용 모니터링이 쉬워지지만, 대시보드 UI가 추가적인 학습 곡선을 만든다.

- 피드백 루프: 지속적인 성능 개선이 가능하지만, 루프가 과도하게 반복될 경우 비용 효율이 역효과를 낼 수 있다.

Legal & Policy Interpretation

토큰 비용 절감 자체가 법적·정책적 이슈를 야기하지는 않지만, 데이터 최소화 원칙과 연관돼 주목할 필요가 있다. 조직화 과정에서 개인정보가 포함된 텍스트를 자동으로 삭제하거나 마스킹하는 기능을 추가하면 GDPR·PIPA 등 데이터 보호 규정을 보다 쉽게 준수할 수 있다.

Real‑World Use Cases

다양한 산업에서 AgentConductor를 활용한 사례를 살펴보면,

- **고객 지원 챗봇**: 매일 수천 건의 문의를 처리하면서 토큰 비용을 70% 절감, 고객 만족도는 유지.

- **의료 기록 요약**: 민감한 환자 데이터를 압축해 전송 비용을 낮추고, 보안 위험을 최소화.

- **금융 리포트 자동 생성**: 복잡한 재무 데이터를 요약하면서도 정확도는 기존 수준 유지, 비용은 절반 이하.

Step‑by‑Step Action Guide

실무자가 바로 적용할 수 있는 단계별 가이드는 다음과 같다.

- 프로젝트에 AgentConductor SDK를 설치한다.

pip install agentconductor - 기존 프롬프트를

organize_prompt()함수에 전달해 초기 압축을 수행한다. - 압축된 프롬프트를 LLM에 호출하고, 반환된 토큰 수를

log_token_usage()로 기록한다. - 피드백 루프를 활성화해

refine_prompt()를 주기적으로 실행한다. - 대시보드에서 비용 추이를 모니터링하고, 목표 절감 비율에 도달하지 못하면

compression_level파라미터를 조정한다.

FAQ

- Q: 모든 LLM에 적용 가능한가? A: 현재 OpenAI, Anthropic, Cohere 등 주요 모델을 지원한다. 커스텀 모델도 API 스키마만 맞추면 적용 가능하다.

- Q: 압축 과정에서 중요한 정보가 사라지지는 않을까? A: 기본 설정은 정보 손실을 최소화하도록 설계돼 있다. 필요 시

preserve_keywords옵션으로 핵심 용어를 고정할 수 있다. - Q: 실시간 서비스에 적용하면 레이턴시가 늘지 않을까? A: 압축 단계는 보통 10~30ms 정도 소요된다. 고성능 환경에서는 비동기 처리로 레이턴시 영향을 최소화한다.

Conclusion

AgentConductor는 토큰 비용을 획기적으로 낮추면서도 모델 성능을 유지하는 실용적인 솔루션이다. 비용 절감은 곧 제품 경쟁력 강화와 직결되므로, 개발팀은 아래 액션 아이템을 즉시 실행해야 한다.

- 프로젝트 초기 단계에서 AgentConductor SDK를 도입하고, 기존 프롬프트를 조직화한다.

- 토큰 사용량을 실시간 모니터링해 목표 절감 비율(>60%)을 설정한다.

- 데이터 보호 정책에 맞춰 민감 정보 자동 마스킹 옵션을 활성화한다.

- 주기적인 피드백 루프를 통해 압축 수준을 최적화하고, 레이턴시가 허용 범위 내에 있는지 검증한다.

이러한 절차를 따르면, 기업은 AI 서비스 운영 비용을 크게 낮추면서도 사용자 경험을 유지하거나 향상시킬 수 있다.

관련 글 추천

- https://infobuza.com/2026/04/07/20260407-0200xq/

- https://infobuza.com/2026/04/07/20260407-2jfcmu/

지금 바로 시작할 수 있는 실무 액션

- 현재 팀의 AI 활용 범위와 검증 절차를 먼저 문서화합니다.

- 작은 파일럿 프로젝트로 KPI를 정하고 2~4주 단위로 검증합니다.

- 보안, 품질, 리뷰 기준을 자동화 도구와 함께 연결합니다.