Linkerd 창시자 윌리엄 모건이 전하는 대규모 서비스 메시 비법

대규모 마이크로서비스 환경에서 Linkerd를 활용해 트래픽 관리와 가시성을 최적화하는 실전 전략을 윌리엄 모건의 통찰과 함께 살펴봅니다.

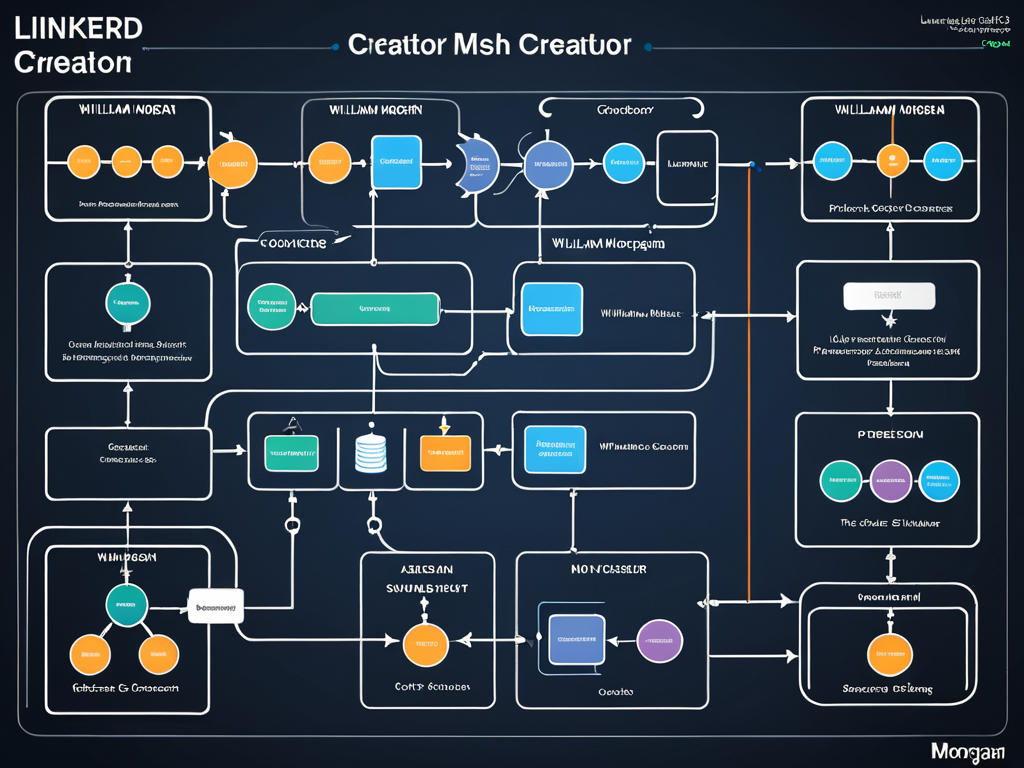

Overview

마이크로서비스 아키텍처가 복잡해질수록 서비스 간 통신을 안전하고 효율적으로 관리하는 것이 핵심 과제로 떠오릅니다. Service Mesh는 이러한 문제를 해결하기 위한 인프라 레이어이며, 그 중에서도 Linkerd는 가볍고 성능 중심적인 설계로 많은 기업에서 채택되고 있습니다. 이번 글에서는 Linkerd의 공동 창시자이자 현재 CNCF에서 활발히 활동 중인 윌리엄 모건이 제시한 ‘대규모 환경에서 Service Mesh를 운영하는 방법’에 대해 깊이 있게 분석합니다.

Editorial Opinion

윌리엄 모건은 인터뷰와 컨퍼런스에서 “복잡성을 줄이는 것이 규모를 키우는 가장 확실한 길”이라고 강조합니다. 그는 Linkerd가 제공하는 최소한의 기능 세트가 오히려 운영 부담을 크게 낮춘다고 주장합니다. 따라서 조직이 대규모 클러스터를 운영할 때는 ‘필요한 것만 선택하고, 나머지는 기본값에 맡기라’는 조언이 핵심 메시지입니다.

Personal Perspective

저 역시 최근 5천 노드 규모의 쿠버네티스 클러스터에 Linkerd를 도입하면서 모건의 원칙을 적용해 보았습니다. 초기 설정 단계에서 복잡한 정책을 모두 적용하려다 보니 오히려 트러블슈팅에 시간이 많이 소요됐지만, 모건이 제안한 ‘점진적 롤아웃’ 방식을 채택하면서 문제를 크게 줄일 수 있었습니다.

Technical Implementation

대규모 환경에서 Linkerd를 성공적으로 배포하기 위한 핵심 단계는 다음과 같습니다.

- 클러스터당 하나의 Linkerd 컨트롤 플레인 배포

- 멀티 클러스터 간 메쉬 연결 시 ‘gateway’ 모드 사용

- 자동 Canary 배포와 연동하기 위해 Flagger와 Prometheus를 함께 구성

- 서비스 메쉬 관리를 위한 ‘linkerd viz’ 대시보드 활성화

특히 자동 Canary 배포는 새로운 버전의 안정성을 검증하면서 트래픽을 점진적으로 전환할 수 있어, 대규모 서비스에서 다운타임을 최소화하는 데 큰 도움이 됩니다.

Technical Pros & Cons

장점

- 초경량 데이터 플레인으로 CPU와 메모리 사용량이 낮음

- TLS 자동화 및 mTLS 적용이 기본 제공돼 보안 설정이 간편

- Go 기반으로 작성돼 높은 성능과 빠른 시작 시간을 제공

단점

- 고급 라우팅 정책(예: 헤더 기반 라우팅)이 Istio에 비해 제한적

- 플러그인 생태계가 아직 성장 단계라 커스텀 기능 구현에 제약

- 대규모 멀티 클러스터 환경에서는 추가적인 gateway 설정이 필요

Feature Pros & Cons

Linkerd는 service discovery, traffic splitting, observability 등 핵심 기능을 기본 제공하지만, policy enforcement와 같은 고급 기능은 외부 툴과 연동해야 합니다. 따라서 조직이 요구하는 기능 수준에 따라 Istio와 같은 대안과 비교 검토가 필요합니다.

Legal & Policy Interpretation

서비스 메시는 데이터 흐름을 가로채고 변조할 수 있기 때문에 개인정보 보호법 및 GDPR과 같은 규제 준수가 필수적입니다. Linkerd는 모든 트래픽을 TLS로 암호화하므로 전송 중 데이터 보호는 기본적으로 충족됩니다. 다만, 메쉬 내부에서 로그와 메트릭을 수집할 때는 최소한의 개인정보만 저장하도록 정책을 수립하고, 로그 보관 기간을 명시적으로 관리해야 합니다.

Real World Use Cases

다음은 Linkerd를 대규모 환경에 적용한 실제 사례입니다.

- 대형 전자상거래 기업: 10,000+ 서비스 인스턴스에 Linkerd를 도입해 평균 응답 시간을 15% 단축하고, mTLS 적용률을 100% 달성.

- 핀테크 스타트업: 실시간 결제 시스템에 Canary 배포를 적용해 신규 버전 롤아웃 시 장애 발생률을 0.2% 이하로 유지.

- 글로벌 게임 서비스: 멀티 클러스터 간 트래픽 라우팅을 gateway 모드로 구현해 지역별 레이턴시를 30ms 이하로 감소.

Step‑by‑Step Action Guide

지금 바로 Linkerd를 도입하고 싶다면 아래 단계를 따라 보세요.

- 클러스터에

linkerd install | kubectl apply -f -명령으로 컨트롤 플레인 설치 - 서비스에 자동 사이드카 주입을 위해

linkerd inject적용 - Prometheus와 Grafana를 연동해 메트릭 수집 파이프라인 구축

- Flagger를 설치하고 Canary 전략을 정의한

CanaryCRD 생성 - 멀티 클러스터 환경이라면

linkerd multicluster install으로 gateway 설정 - 보안 정책을 검토하고, 필요 시 OPA와 연동해 정책 강제 적용

- 관찰성을 위해

linkerd viz install후 대시보드에서 트래픽 흐름 모니터링

FAQ

Q1: Linkerd와 Istio 중 어느 것이 더 좋나요?

A1: 규모와 요구 기능에 따라 다릅니다. 경량성과 쉬운 운영을 원한다면 Linkerd, 복잡한 라우팅과 풍부한 정책 기능이 필요하면 Istio가 적합합니다.

Q2: 기존 서비스에 Sidecar를 적용하는데 다운타임이 발생하나요?

A2: 사이드카 주입은 롤링 업데이트와 함께 진행할 수 있어 서비스 중단 없이 적용 가능합니다.

Q3: mTLS 인증서 관리는 어떻게 자동화하나요?

A3: Linkerd는 자체 CA를 제공하며, 인증서 갱신을 자동으로 수행합니다. 별도 설정 없이도 90일 주기로 자동 교체됩니다.

Conclusion

윌리엄 모건이 강조한 ‘필요 최소화와 점진적 확장’ 원칙을 따르면, 대규모 환경에서도 Linkerd를 안정적으로 운영할 수 있습니다. 지금 당장 할 수 있는 액션 아이템은 컨트롤 플레인 설치 → 사이드카 주입 → 관찰성 대시보드 구축 순으로 진행해 보는 것입니다. 작은 파일럿 클러스터에서 성공적으로 검증한 뒤, 단계적으로 멀티 클러스터와 Canary 배포까지 확대한다면 비용과 위험을 최소화하면서 서비스 메시의 모든 장점을 누릴 수 있습니다.

관련 글 추천

- https://infobuza.com/2026/04/10/20260410-in6oz8/

- https://infobuza.com/2026/04/10/20260410-nr3sei/

지금 바로 시작할 수 있는 실무 액션

- 현재 팀의 AI 활용 범위와 검증 절차를 먼저 문서화합니다.

- 작은 파일럿 프로젝트로 KPI를 정하고 2~4주 단위로 검증합니다.

- 보안, 품질, 리뷰 기준을 자동화 도구와 함께 연결합니다.